Mal wieder gescheitert. In der Endlosschleife beim Chatbot gefangen. Auf unendlicher Suche nach dem passenden Produkt im Onlineshop. Vorschläge vom Sprachassistenten, die vielleicht irgendwann, aber ganz bestimmt nicht jetzt und heute passen. Und und und. Wir kennen genug Beispiele, an denen wir an Systeme scheitern, die einfach nicht gut genug sind, um uns als Kunden weiterzuhelfen. »Hätte ich nur einen menschlichen Ansprechpartner, der mich wirklich versteht!« Siri und Alexa schaffen das bisher nicht. Aber wie ist das eigentlich mit den neuen Möglichkeiten durch KI? Können künstliche Systeme empathisch wie ein Mensch auf sein Gegenüber eingehen?

Schon heute sind mit Chatbots Gesprächsverläufe möglich, bei denen man nicht merkt, ob sich im Hintergrund ein echter Mensch, oder doch eine KI verbirgt. Der Turing-Test aus den 1950’er Jahren, der Informatiker*innen seit Jahrzehnten vor die Herausforderung stellt, genau dies zu schaffen – scheint nahezu gelöst. Doch ist es wirklich schon damit getan? Oder beginnt es jetzt erst? Welche weiteren Fragestellungen ergeben sich, wenn eine KI in der Kommunikation nur noch schwer vom menschlichen Gegenüber zu unterscheiden ist?

Wie KI-Systeme empathisch werden können

Ein wesentlicher Bestandteil der menschlichen Kommunikation ist die Empathie – also die Fähigkeit, sich in das Gegenüber hineinzuversetzen, dessen gegenwärtigen psychischen Zustand nachzuempfinden, und angepasst darauf zu reagieren. Erst durch empathische Reaktionen können schwierige Situation u.a. in Konfliktgesprächen entschärft und zu einer konstruktiven Lösung gebracht werden. Die menschliche empathische Reaktion besteht aus einer Vielzahl von Sinneseindrücken und daraus resultierenden Entscheidungen, die sich aus Erfahrungswissen und Intuition speisen.

Erfahrungswissen – ein Schlagwort, dass auch in KI-Systemen eine wichtige Rolle spielt. Werden doch KI-Systeme häufig auch als »lernende Systeme« bezeichnet, die aus den Daten der Vergangenheit Schlüsse ableiten können und dadurch zu immer besseren Entscheidungen kommen.

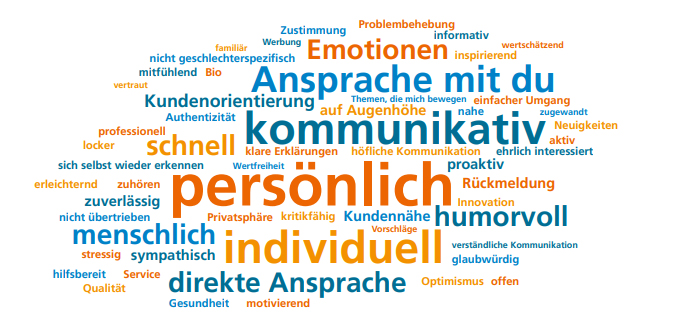

Schon heute gibt es – in ersten Ansätzen – künstlich-empathische Systeme, die auf den psychischen Zustand des Gegenübers reagieren. Dies geschieht beispielsweise, wenn im Chatbot mit Hilfe von so genannten Sentiment-Analysen aus Texten der gegenwärtige Zustand des Nutzenden interpretiert wird. Aktuell ist es aber in vielen Situation noch sehr schwierig, den aktuellen Gefühlszustand des menschlichen Gegenübers verlässlich herauszufinden. Genau das wäre aber nötig, um dann auch passende Systemreaktionen gestalten zu können. Denn mit dem Erfassen des Zustands alleine ist es noch nicht getan – anschließend muss ja auch eine darauf angepasste Antwort erfolgen, die das menschliche Gegenüber empathisch abholt. Dieses Gestalten der passenden Reaktion ist ein Feld für sich mit ganz eigenen Schwierigkeiten, bei denen auch individuelle Unterschiede eine große Rolle spielen können.

Emotionen können manipulieren – oder Vertrauen schaffen

Bei allem, was heute schon technisch möglich ist, dürfen jedoch ethische Gesichtspunkte nicht vernachlässigt werden. Immer wichtiger wird es, empathische Reaktionen von Manipulationen abzugrenzen und Vertrauen bei den Kund*innen aufzubauen. In Gesprächen mit Expert*innen, aber auch in einer Umfrage mit Nutzer*innen haben wir festgestellt, dass darin ein wesentlicher Gestaltungspunkt für künstlich-empathische Systeme liegt, der die Akzeptanz entscheidend beeinflussen wird. Die Gestaltung von künstlich-empathischen Systemen erfordert Fingerspitzengefühl, um es für die Menschen positiv zu gestalten – ohne Gruselfaktor und Überwachung. Auch ist die gesellschaftliche Diskussion ist hier noch nicht so weit, wie die technischen Möglichkeiten gehen. Bei künstlichen-empathischen Systemen geht es nicht mehr nur um Datenschutz, sondern auch um die Vermeidung von Manipulationen und um Transparenz und Erklärbarkeit.

Wie sich ein System künstlich-empathisch verhalten solle, müssen wir das in unserer Gesellschaft noch viel intensiver diskutieren. Mit unserer Studie »Kundenservice empathisch gestalten« tragen wir zu dieser Diskussion bei und beleuchten die unterschiedlichen Aspekte bei der Gestaltung künstlich-empathischer Systeme – von technischen Herausforderungen bis hin zu ethischen Gesichtspunkten. Die Studie wird abgerundet durch ein Reflektionskapitel, das Unternehmen hilft, die eigenen Gestaltungsideen kritisch zu untersuchen und zu optimieren. Lassen Sie sich inspirieren und gestalten Sie künstlich-empathische Systeme, die im besten Sinn intelligent sind – nämlich zum Nutzen des Menschen. Wir stehen gerne zum Austausch zu diesem spannenden Thema bereit.

Selbstversuch mit einem empathischen Chatbot

Leselinks:

- Studie »Kundenservice empathisch gestalten«

- Human-Centered AI am Fraunhofer IAO

-

Fiktionale Dystopie: Marc-Uwe Kling hat eine Satire auf die Zukunft geschrieben, die längst begonnen hat

Kategorien: Künstliche Intelligenz, New Work / Connected Work

Tags: Affective Computing, KI - Künstliche Intelligenz, Kundenservice